AMD breddar sin DataCenter portfölj med nya EPYC processorer, nätverksprodukter och fokus på generativ AI.

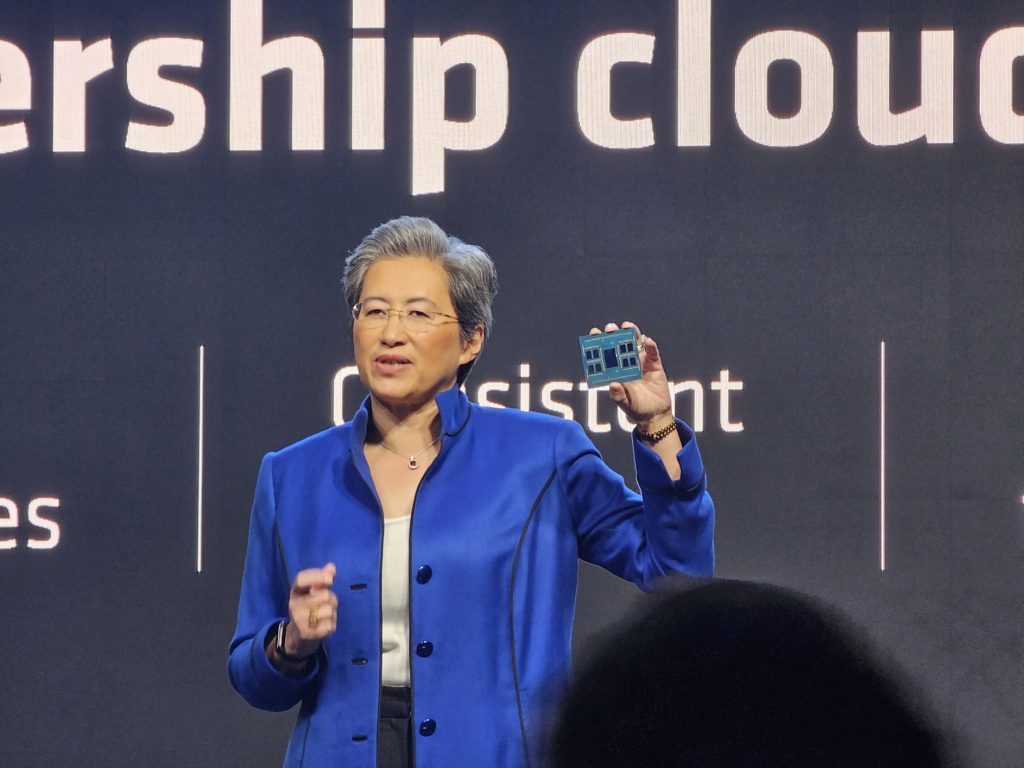

Under sitt numera traditionella, återkommande, datacenterevent i San Francisco den 13 juni 2023, visade Lisa Su, AMD:s CEO bland annat upp företagets senaste Epyc processorer i form av fjärde generationens AMD EPYC 97X4, vilken tidigare gått under kodnamnet Bergamo. Datormagazin var på plats och fick under en fullmatad dag även en nära inblick i AMDs genomgripande AI-vision.

Magin i AMDs Chiplet

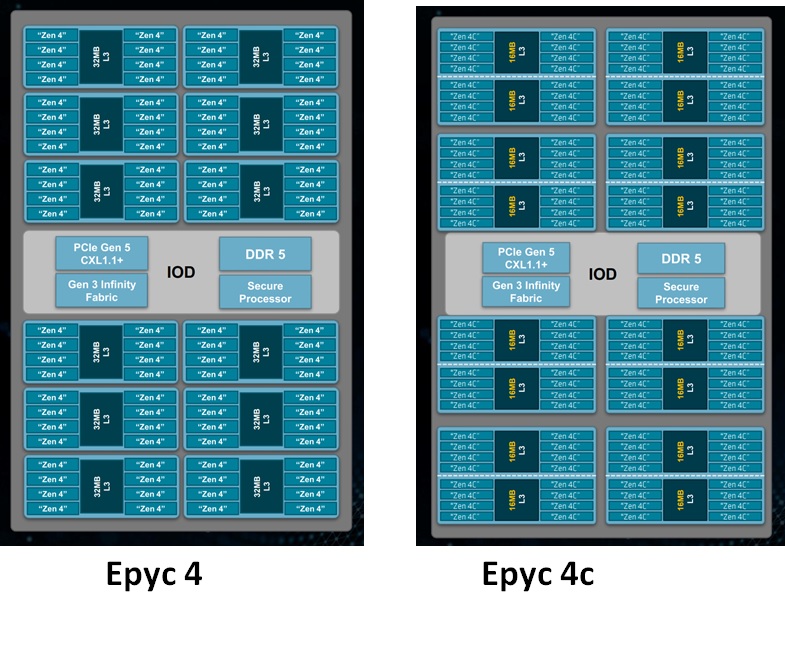

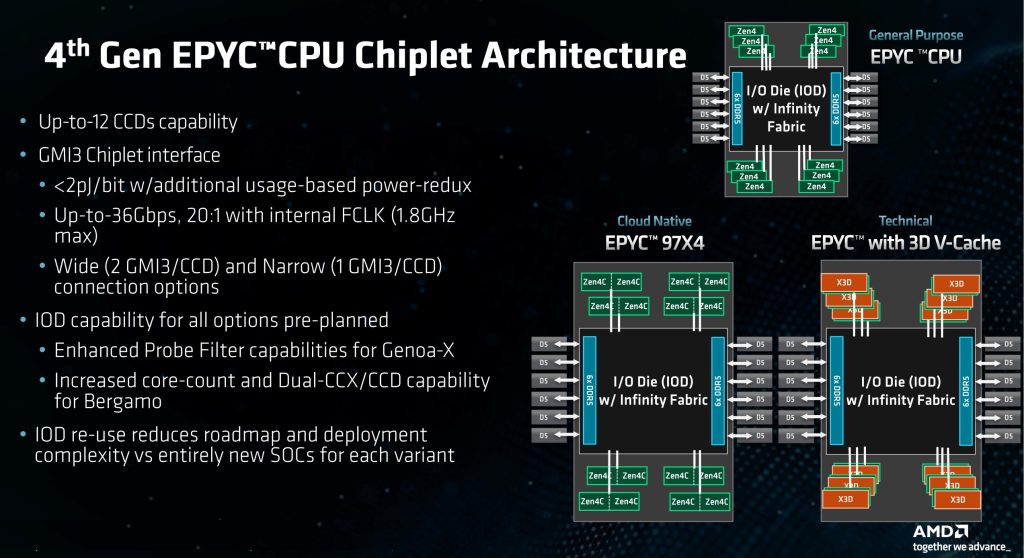

Zen 4 arkitekturen är i sig inte någon nyhet då den lanserades den 27 september 2022 då vi för första gången fick stifta bekantskap med företagets 5 nanometers arkitektur och upp till tolv kanalers DDR5, stöd för PCIe Gen5 och minnesexpansion via CXL samt integrerad 6 nanometers IO hantering. Toppmodellen för denna lansering hette 9654P och kom med 96 Zen4 kärnor. Men med start den 13 juni 2023 så presenterade AMD nästa generationsmolnoptimerade DC processorer i form av Zen 4C, där C står för Cloud, serien 97X4. Detta är modeller som erbjuder upp 128 Zen4 kärnor vilket är den högsta vCPU densiteten till dags datum. Detta maximerar såväl prestandamöjligheterna för molnbaserade applikationer och erbjuder klassledande energieffektivitet. Till detta så visade AMD även upp ytterligare en specialvariation kallad Genoa-X vilket är en serie som är optimerad för mer tekniskt orienterade uppgifter som automatiserad design eller Fluid Dynamics.

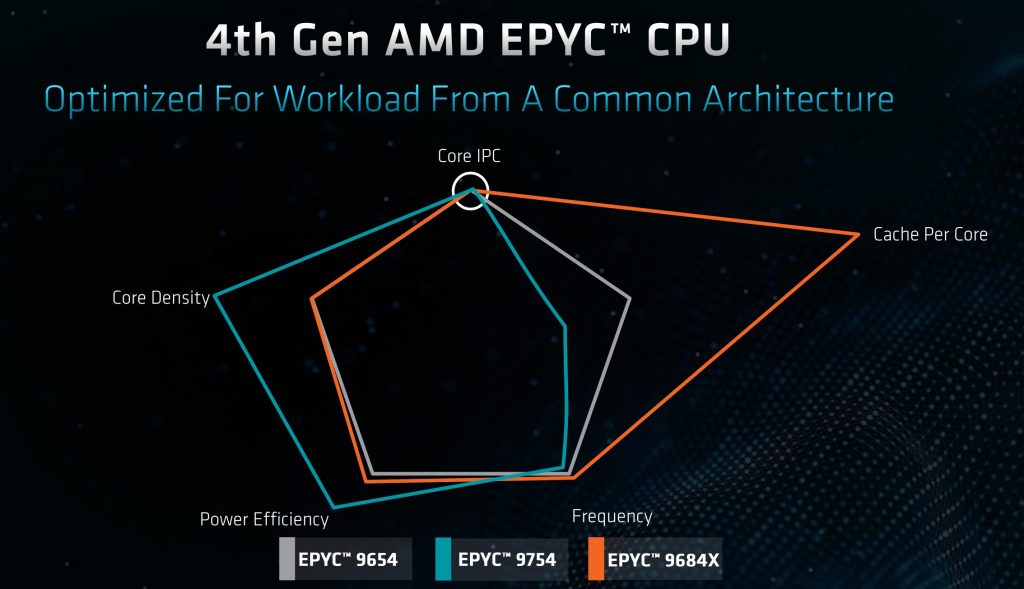

Detta gör att AMD kan erbjuda fjärde generationens Epyc processorer med tre olika inriktningar där de delar samma Core IPC grund men sedan optimerats för olika användningsområden. Genoa-X har primärt utrustas med en markant större cache per kärna medan Bergamo uppnår en högre densitet där AMD lyckats minska Core + L2 ytan från 3,84 kvadratmillimeter ifrån basmodellen till låga 2,48 kvadratmillimeter för Cloudmodellerna.

Grunden till att AMD kan anpassa samma serie på detta sätt kan vi direkt spåra till deras Chiplet arkitektur. Denna kan, väldigt enkelt, förklaras som ett legobaserat system där AMD kan ta bort och lägga till delar på samma sätt som vi byter ut legoklossar. För att sedan lyckas minska fotytan för processorn så har AMD sedan även, förutom en minskad cache, sänkt kärnfrekvensen manuellt vilket ger en lägre värmeutveckling. Detta tillsammans med vissa arkitektoniska förändringar, som blivit möjliga tack vare den lägre temperaturen, som tätare placering av kretsar gör det alltså möjligt att minska den fysiska storleken med dryga 35 procent utan någon större inverkan på prestandan.

- Tack vare vår Chipletdesign så har vi på ett relativt enkelt vis kunnat optimera vår fjärde serie Epyc processorer för tre ändamål. Den, på många sätt, mest intressanta av dessa är 4C där vi lyckats krypa den fysiska yta som processorn upptar med en dryg tredjedel men trots detta minimera prestandaförsämringen som i många fall inte ens är märkbar men som i vissa specifika fall bara sjunker med 5-7 procent vilket är en fantastiskt ingenjörsprestation och som även tydligt visar styrkan i användande av vår Chiplet design säger Mike Clark, Corporate Fellow Silicon Design engineer, AMD.

- Till skillnad från Bergamo eller Zen4C som har ett fokus på hög vCPU densitet och bästa tänkbara energieffektivt så har Genoa-X i stället optimerats för så kallad teknisk databearbetning som vid design, modellering eller simulering med flera områden. För att ge denna serie bästa grund så används 3D V-cache med upp till hela 1,1 gigabyte L3 cache vilket kan jämföras med 384 megabyte för vår General purpose serie. Detta medför att våra modeller kan prestera upp till tre gånger högre prestanda inom teknisk datoranvändning per kärna jämfört med våra konkurrenter berättar Ram Peddibholta, CVP, AMD.

Datacenteroptimerad infrastruktur

Nu handlade inte eventet bara om nya Epyc4 modeller och dess arkitektoniska skillnader och möjligheter som återfinns i Chiplet designen. AMD har nämligen tagit ett betydligt större kliv och skapat ett mer komplett ekosystem kring datorinfrastruktur vilken är optimerad för Datacenterbaserde belastningar. Detta genom att komplettera Genoa-X, Bergamo och kommande modeller med smarta lösningar inom nätverk och AI samt kommande lansering av Telco/Edge optimerade CPU modellerna kallade Siena.

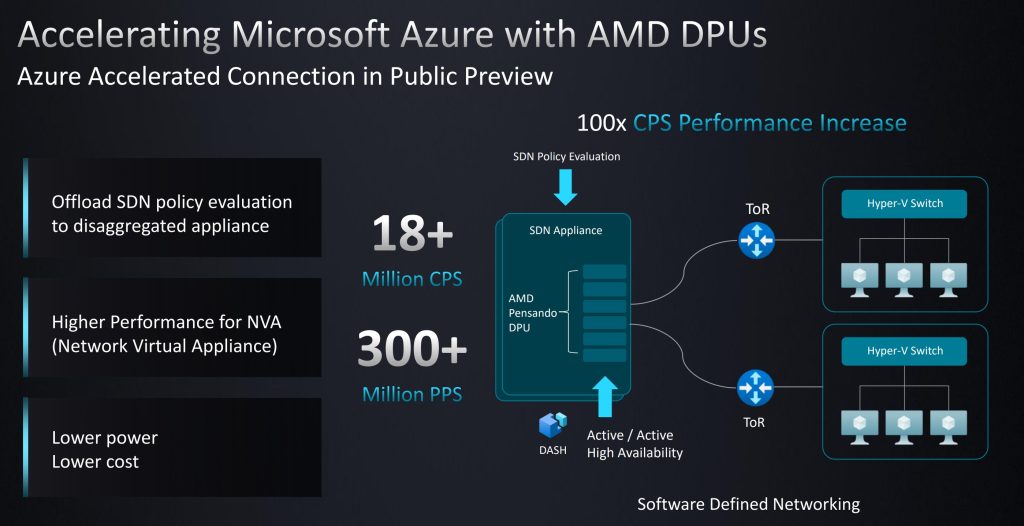

Börjar vi med nätverks sidan så erbjuder AMD sedan en tid tillbaka smarta nätverkslösningar baserade på det så kallade Pensando chippet. Detta är en lösning som dels ökar säkerheten i nätverken utan att inverka på prestandan och som dels avlastar ett stort antal infrastrukturella tjänster optimerade för moln- och virtualisering.

Lösningen kompletteras sedan med smarta switchar som utrustats med AMD Pensando P4 DPU chip vilka både hjälper till att kraftigt accelerera prestandan, öka den generella prestandan och öka synligheten i infrastrukturen. Lösningen som sådan är dessutom direkt anpassningsbar i alla större publika molntjänster.

- Genom att gå över till lösningar som baseras på AMDs Pensando P4 DPU lösning så har vi sett en snudd på overklig prestandaökning med över hundra gånger flera CPS (Calls Per), jämfört med tidigare lösning. Detta dessutom med en lägre energiförbrukning och till en lägre totalkostnad. Till detta så får vi en tydlig avlastning för våra SDN lösningar och en högre NVA prestanda (Network Virutal Appliance) där vi med en NVA acceleration kunnat minska antalet kärnor från 30 till 8 med bibehållen eller även ökad prestanda. Ser vi detta sedan i ett kundperspektiv så innebär det upp till ett tiofalt prestandakliv med en dubblering av aktiva anslutningar vilket är ett av de mest markanta, omedelbara, prestandakliv vi sett berättar Gerald Degrace, TPM manager, Microsoft.

- Med vår P4 DPU arkitektur så kan vi erbjuda världens mest intelligenta databehandlingsenheter med fullt programmerbara, kontroll- data- och hanteringsplan. P4 motorn är optimerad för hantering och behandling av nätverksbaserade dataflöden och stödjer upp till tio miljontals simultana nätverksflöden. Med avlastningen som vår P4 DPU erbjuder så förbättras agiliteten samtidigt som overheaden för olika typer av virtualisering i det närmast helt elimineras vilket i sin tur minskar behovet av olika former av hjälpmedel. Då lösningen kan implementeras i såväl nya som befintliga infrastrukturer så kan företag med en minimal investering sänka sin TCO samtidigt som prestandan ökas, säger Forrest Norrod, EVP och GM Data Center Solutions Business Group, AMD.

Megatrendernas givna etta – AI

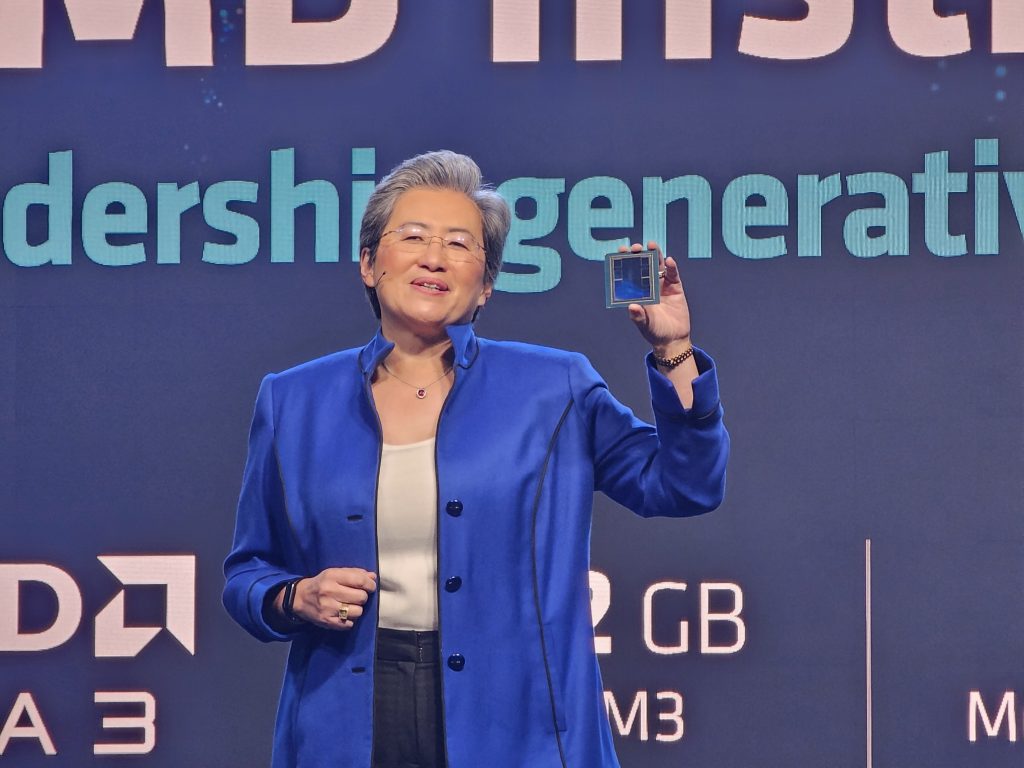

Vi avrundar med den, enligt undertecknad, klart mest intressanta, AMDs tydliga intåg på AI marknaden och detta i form av AMD Alveo samt framför allt Instinct Accelerators. Under eventet så presenterade Lisa Su AMD Instinct MI300A som är världens första APU accelerator för AI och HPC. Detta är en enhet som kommer utrustad med24 Zen4 CPU kärnor, 128 gigabyte HBM3 och som bygger på en fem och sex nanometers process teknologi och där CPU och GPU kärnor delar på samma minne.

Till denna så lanseras även MI300X som erbjuder 5,2 terabytes per sekund i minnesbandbredd, 896 gigabyte per sekund infinity fabrik bandbredd samt är utrustad med 153 miljarder transistorer. Jämför vi detta med konkurrenten Nvidia H100 så ger AMDs lösning upp till 2,4 gånger högre HBM densitet samt 1,6 gånger högre HBM bandbredd. Denna lösning lanseras även som en färdig plattform bestående av totalt åtta sammanlänkade MI300X GPUer vilka då erbjuder hela 1,5 terabyte HBM3 minne.

För att i lite vidare drag förklara nyttan och kraften i en AI driven infrastruktur så avser den, precis som namnet antyder, användningen av artificiell intelligens (AI)-teknik för att optimera och hantera olika aspekter av en organisations infrastruktur. Det innebär att utnyttja AI-algoritmer och tekniker för att automatisera och förbättra effektiviteten, prestandan och tillförlitligheten hos infrastrukturkomponenter som nätverk, servrar, lagringssystem och datacenter. En AI-driven infrastruktur kan omfatta en rad applikationer, så som:

- Prediktivt underhåll: AI-algoritmer kan analysera data från sensorer och övervakningssystem för att identifiera potentiella problem eller fel i infrastrukturkomponenter. Genom att förutsäga underhållsbehov kan organisationer proaktivt ta itu med problem, minska stilleståndstiden och optimera resursallokeringen.

- Resursoptimering: AI kan analysera historisk data, användarmönster och arbetsbelastningskrav för att optimera resursallokeringen. Detta kan inkludera dynamisk allokering av datorresurser, optimering av nätverksbandbredd eller balansering av serverarbetsbelastningar för att förbättra prestanda och kostnadseffektivitet.

- Intelligent automation: AI kan automatisera rutinuppgifter som systemprovisionering, konfigurationshantering och programuppdateringar. Genom att automatisera dessa processer kan organisationer minska den manuella inblandningen och dess resurser, minimera mänskliga fel och öka den operativa effektiviteten.

- Säkerhet och hotdetektion: AI kan analysera nätverkstrafik, loggdata och användarbeteende för att upptäcka anomalier och potentiella säkerhetshot. Maskininlärningsalgoritmer kan lära av mönster och identifiera misstänkta aktiviteter, vilket möjliggör snabbare svarstider och förbättrad säkerhet.

- Energieffektivitet: AI-algoritmer kan optimera energiförbrukningen i datacenter genom att dynamiskt justera kylning, belysning och strömförbrukning baserat på arbetsbelastning och miljöförhållanden. Detta kan resultera i betydande energibesparingar och minskade driftskostnader.

Sammantaget syftar AI-driven infrastruktur till att utnyttja kraften hos AI för att göra infrastrukturhanteringen mer intelligent, effektiv och anpassningsbar. Genom att utnyttja avancerad analys, automatisering och förutsägelsekapacitet kan organisationer förbättra prestanda, minska kostnaderna och förbättra den totala operativa effektiviteten och här ligger AMD med sina nya lanseringar mycket väl positionerad. För att göra det hela än mer intressant så hintades även under eventen om kommande lösningar och produkter och det är inte utan att det känns som att övriga konkurrenter verkligen har något att bita i för att hänga med.