Intel använder AI för att bekämpa AI för att med hjälp av realtidsanalys av ”blodflöde” i videopixlar kunna avslöja falska video

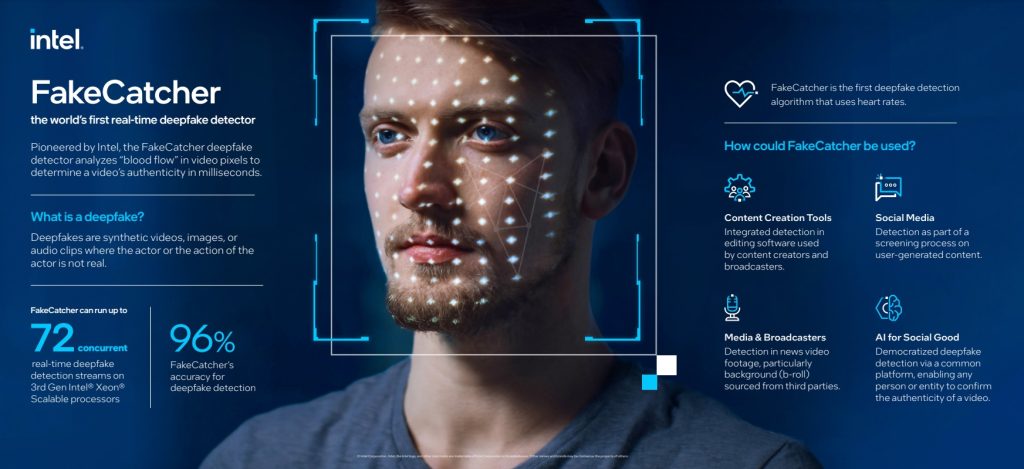

Den snabba framväxten av deepfake-teknik har fört fram en ny era av oro när det gäller äktheten hos digitala medier. Deepfakes, som är mycket realistiskt manipulerade videor eller bilder, har potential att lura och manipulera tittare i alla åldrar och i alla sammanhang, vilket innebär betydande utmaningar för alla branscher men kanske framför allt de som journalistik, underhållning och nationell säkerhet. Intel insåg tidigt behovet av att bekämpa detta framväxande hot och har utvecklat en avancerad lösning för deepfake-detektion som syftar till att identifiera och minimera effekterna av manipulerade medier. Datormagazin fick möjlighet till ett samtal med Ilke Demir, Senior Research Scientist vid Intel Corporation och en av utvecklarna av FakeCatcher vars plattform, med 96 procents säkerhet kan identifiera felaktiga, manipulerade, videos för att höra hennes syn på den ökade hotbilden och vad Intel gör för att underlätta för såväl digital kriminalteknik som trovärdighetsverifiering.

Tre-stegsbas

Intels Deepfake-detektor utnyttjar en kombination av traditionella datorseendealgoritmer och banbrytande tekniker för djupinlärning för att analysera och identifiera potentiella tecken på manipulation i olika former av multimediainnehåll. Detektorn följer en flerstegs pipeline vilken inkluderar förbearbetning, funktionsextraktion och klassificeringssteg

- Förbearbetning: Detektorn börjar med att förbehandla inmatningsmediet, vilket kan innehålla videor, bilder eller sekvenser av bildrutor. Förbearbetning innebär att normalisera data, minska brus och förbättra kvaliteten på innehållet för att förbättra efterföljande analys.

- Funktionsextraktion: I funktionsextraktionsstadiet extraherar detektorn relevanta visuella egenskaper från det förbehandlade mediet. Dessa funktioner kan inkludera olika kännetecken i ansiktet, hudstrukturer, rörelsemönster och rumsliga relationer mellan objekt. Både manuella funktioner och inlärda funktioner från djupa neurala nätverk används för att fånga särskiljande egenskaper hos äkta och manipulerat innehåll.

- Klassificering: Efter funktionsextraktion använder detektorn en klassificeringsmodell för att bestämma sannolikheten för att ett givet medieprov är en djupförfalskning. Klassificeringsmodellen, vanligtvis tränad på en stor datamängd som innehåller både verkliga och syntetiska medier, använder maskininlärningsalgoritmer som Convolutional neural networks (CNN) eller Recurrent neural networks (RNN) för att göra förutsägelser. Dessa modeller lär sig mönster och oregelbundenheter som är specifika för deepfakes, vilket möjliggör en mer exakt detektering.

Rigorös träningsfas

Precis som för människor så måste även en AI baserad motor som FakeCatcher tränas för att bli så bra som möjligt. Att träna en effektiv Deepfake-detekteringsmodell kräver en mångsidig och representativ datauppsättning. Intel har samarbetat med experter inom området för att skapa en omfattande datauppsättning som omfattar ett brett utbud av Deepfake-tekniker, inklusive ansiktsbyten, blodflöden i vener, läppsynkroniseringsmanipulation och återskapande av hela huvudet med flera. Denna datamängd tillhandahåller den nödvändiga stommen för att underlätta övervakat lärande och modellträning.

Under träningsprocessen lär sig Deepfake-detektorn att skilja mellan äkta och manipulerade media genom att optimera dess interna parametrar med hjälp av gradient-descent-algoritmer. Inlärningsprocessen innebär att iterativt presenterar specifika exempel för modellen, utvärderar dess förutsägelser och justerar modellens bedömningar för att minimera klassificeringsfel. Denna iterativa process fortsätter tills modellen uppnår en tillfredsställande nivå av noggrannhet och generalisering. Genom att införliva tekniker för djupinlärning kan detektorn anpassa och lära sig av storskaliga datauppsättningar, vilket i sin tur förbättrar dess förmåga att upptäcka mer sofistikerade och utvecklande Deepfake metoder

Fokus på det äkta

Intel’s Deepfake detection platform, som är den första i sitt slag, upptäcker Deepfake material i realtid med en resultatåterkoppling på bara millisekunder. Men till skillnad mot tidigare, alternativa, lösningar som fokuserat på att hitta felaktigheter i materialet som analyseras så har Intel under ledning av Ilke Demir tagit en annan approach då plattformen fokuserar på det som är äkta.

- Vi hittar numera Deepfake videos och annat material överallt och trots att du kanske inte vet om det så har du troligen redan stött på det i olika sammanhang. Många gånger handlar det om olika kändisar eller celebriteter som gör eller säger något som i verkliga livet aldrig gjort. För att komma åt och identifiera dessa potentiella bedrägerier så har vi byggt FakeCatcher så att den bakomliggande motorn letar efter autentiska ledtrådar och signaler i de videos som analyseras, eller kort och gott vi söker efter områden som gör oss till äkta människor, berättar Ilke.

- Ett av de bästa sätten att göra detta på är att fokusera på subtilt ”blodflöde” i pixlarna i en video. När våra hjärtan pumpar blod ändrar våra vener färg. Dessa blodflödessignaler samlas in från hela ansiktet och med hjälp av avancerade algoritmer översätter dessa signaler till spatiotemporala kartor. Härefter kan vi, med hjälp av djupinlärning, omedelbart upptäcka om en video är äkta eller falsk. Detta i realtid och med upp till 96 procents säkerhet.

Praktiska tillämpningar

Redan i skrivandes stund så uppskattar Gartner att företag under kommande år kommer att spendera upp mot 200 miljarder dollar i cybersäkerhetslösningar där en av de drivande anledningarna för denna satsning ligger i det växande hotet från olika former av Deepfake material. Olika former av bedrägeri orsakde på grund av Deepfakes kan orsaka skada och resultera i negativa konsekvenser, som minskat förtroende för media eller även manipulerade av människors åsikter, rent allmänt eller i värre fall vid exempelvis nationella val med mera.

Strategisk utplaceringen och integrering av Intels Deepfake-detektor kan ha djupgående, positiva, konsekvenser inom olika branscher och sektorer. Inom journalistik kan detektorn hjälpa till att säkerställa nyhetsrapporteringens integritet genom att verifiera äktheten av visuella bevis och förhindra spridning av felaktig information. Inom underhållningsindustrin kan det hjälpa innehållsskapare att skydda sina immateriella rättigheter och upprätthålla publikens förtroende. Dessutom kan detektorn hjälpa kriminaltekniska utredare att identifiera och analysera Deepfake bevis i rättsliga förfaranden, vilket stärker digitala kriminaltekniska möjligheter och detta är bara att skrapa på ytan till potentialen med Intels lösning.

- Vi arbetar redan med att bredda användningen av FakeCatcher till att omfatta flera områden och genom att använda andra algoritmer så hoppas vi kunna detektera även andra, mer statiska områden, som omgivande miljö med mera, berättar Ilke.

Läs mer om Intels arbete kring ansvarsfullt AI arbete här.